Google のセキュア AI フレームワーク(SAIF)

AI、特に生成 AI がもたらす可能性は計り知れません。技術の進展に伴い、業界には責任ある開発と安全な導入を支えるセキュリティ基準が求められています。そこで Google は、AI システムを安全に運用するための概念的フレームワークとして、セキュア AI フレームワーク(SAIF)を導入しました。

SAIF の 6 つの基本要素

-

強固なセキュリティ基盤を AI エコシステムまで拡大する

-

検出機能と対応機能を拡張し、組織の脅威対策に AI を取り込む

-

防御を自動化し、既存および新規の脅威に対応する

-

プラットフォーム レベルの管理を調整し、組織全体で一貫したセキュリティを確保する

-

コントロールを適応させて緩和策を調整し、AI デプロイのフィードバック ループを高速化する

-

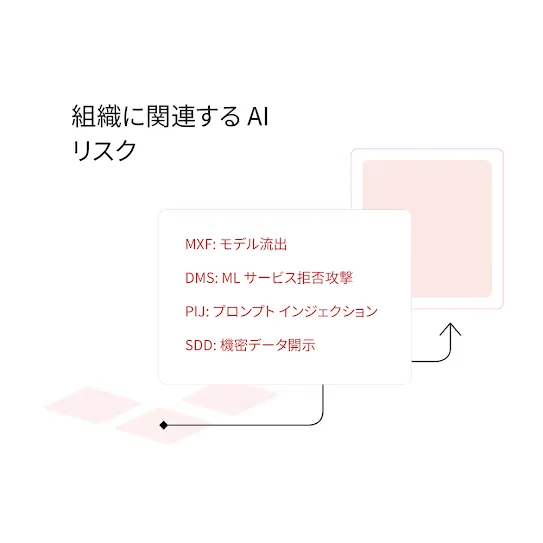

周囲のビジネス プロセスにおける AI システムのリスクをコンテキスト化する

より安全なエコシステムの実現

その他のリソース

SAIF に関する

よくある質問

Google は長年にわたり、責任ある AI とサイバーセキュリティの推進に取り組み、AI イノベーションにセキュリティのベスト プラクティスを組み込んできました。セキュア AI フレームワーク(SAIF)は、その経験とベスト プラクティスをもとに体系化されたもので、ML や生成 AI を活用したアプリケーションにおいて、セキュリティとプライバシーを確保しつつ、柔軟かつ持続可能でスケーラブルな保護を実現するという Google のアプローチを体現しています。今後も、新たなリスクや環境の変化、AI の進歩に対応しながら、SAIF を進化させていきます。

SAIF のフレームワークを導入するためのクイックガイドをご覧ください。

- ステップ 1 - 用途を理解する

- AI で解決できる具体的なビジネス上の問題と、モデルのトレーニングに必要なデータを理解しましょう。SAIF の一部として導入が必要なポリシー、プロトコル、コントロールを設定する際の指針となります。

- ステップ 2 - チームを編成する

- AI システムの開発とデプロイは、従来のシステムと同様に、多分野にまたがる取り組みです。

- AI システムは多くの場合、複雑で不明瞭であり、不確定要素が多く大量のデータに依存し、多くのリソースを必要とします。また、AI システムは評価に基づく決定を下すために使用される場合もあれば、不適切なコンテンツや有害なコンテンツ、固定観念や社会的偏見を助長させる可能性のある新しいコンテンツを生成することもあります。

- セキュリティ、プライバシー、リスク、コンプライアンスへの配慮を確実に最初から組み込むために、適切な部門横断型チームを編成します。

-

ステップ 3 - AI の入門ガイドによりチーム内で認識を共有する

- チームが AI に関して、ビジネスへの活用、高まり続ける複雑性、リスク、セキュリティ管理について評価を行う際には、関係者全員が AI モデル開発ライフサイクルの基本や AI の能力、メリット、制限を含むモデル開発の設計や論理を理解していることが非常に重要です。

-

ステップ 4 - SAIF の 6 つの基本要素を適用する

- これらの要素は、上記の順番どおりに適用する必要はありません。

最新情報を随時ご確認ください。Google は引き続き、AI アプリケーション開発のベスト プラクティスとともに、セキュア AI フレームワークのリソースやガイダンス、ツールを構築し、共有していく予定です。