SAIF,

Le framework d'IA sécurisé de Google

L'IA, et plus particulièrement l'IA générative, présente un potentiel énorme. Plus la technologie progresse, plus le secteur se doit de mettre en place des normes de sécurité pour s'assurer que l'IA est développée et déployée de manière responsable. C'est pourquoi nous avons créé notre framework d'IA sécurisé (SAIF), un cadre pour la conception de systèmes d'IA sécurisés.

Les six principaux éléments du SAIF

-

Développer des bases solides pour la sécurité de l'écosystème d'IA

-

Étendre la détection et la capacité de réponse afin d'intégrer l'IA aux stratégies de protection contre les menaces pesant sur les organisations

-

Automatiser les défenses pour faire face aux menaces nouvelles ou existantes

-

Harmoniser les contrôles au niveau de la plate-forme afin d'assurer une sécurité homogène à travers l'organisation

-

Adapter les contrôles pour pouvoir ajuster les mesures d'atténuation et instaurer des boucles de rétroaction plus rapides pour les déploiements d'IA

-

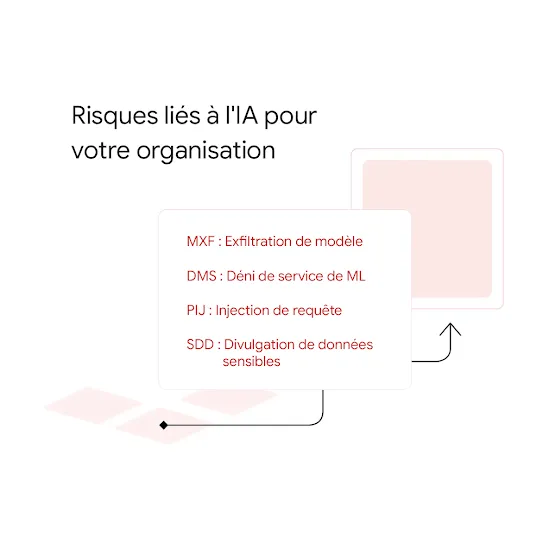

Contextualiser les risques liés aux systèmes d'IA dans les processus métier connexes

Pour un écosystème plus sûr

Autres ressources

Questions fréquentes

sur le SAIF

Google est depuis longtemps un précurseur de l'IA responsable et du développement de la cybersécurité. Depuis de nombreuses années, nous définissons les bonnes pratiques concernant les innovations liées à l'IA. Notre framework d'IA sécurisé découle de notre longue expérience et des bonnes pratiques que nous avons développées et mises en place, et reflète l'approche de Google concernant la conception d'applications basées sur le ML et l'IA générative, dotées de systèmes de protection responsifs, durables et adaptables pour assurer sécurité et confidentialité. Nous continuerons d'adapter et de développer le SAIF pour tenir compte des nouveaux risques, de l'évolution du secteur et des avancées de l'IA.

Consultez notre guide rapide sur l'implémentation du framework SAIF :

- Étape 1 : Comprenez en quoi consistera son utilisation

- Comprendre le problème métier spécifique que l'IA résoudra et les données requises pour entraîner le modèle vous aidera à déterminer les règles, protocoles et contrôles à mettre en place dans le cadre du SAIF.

- Étape 2 : Créez la bonne équipe

- Le développement et le déploiement de systèmes d'IA, comme ceux des systèmes traditionnels, nécessitent la collaboration de plusieurs équipes.

- Les systèmes d'IA sont souvent complexes et peu transparents. Ils incluent de nombreuses variables, reposent sur un grand volume de données et nécessitent beaucoup de ressources. De plus, ils peuvent être utilisés pour prendre des décisions fondées sur un jugement, et le contenu qu'ils génèrent peut être choquant, dangereux ou perpétuer des stéréotypes et des biais sociaux.

- Composez une équipe pluridisciplinaire compétente pour tenir compte des considérations liées à la sécurité, la confidentialité, la gestion des risques et la conformité dès le départ.

-

Étape 3 : Familiarisez toutes les personnes concernées avec l'IA

- Tandis que les équipes entreprennent de déterminer l'utilisation métier de l'IA et les difficultés, risques et contrôles de sécurité variés et changeants qu'elle implique, il est essentiel que les personnes concernées comprennent les notions de base du cycle de vie du développement d'un modèle d'IA , ainsi que le but et la logique des méthodes associées au modèle, y compris leurs capacités, atouts et limites.

-

Étape 4 : Mettez en pratique les six principaux éléments du SAIF

- La mise en application de ces éléments n'a pas forcément besoin de suivre l'ordre chronologique.

Tenez-vous informé ! Google va continuer à concevoir et partager des ressources, recommandations et outils liés au framework d'IA sécurisé, ainsi que d'autres bonnes pratiques concernant le développement d'applications d'IA.

Pourquoi nous voulons une communauté autour de l'IA sécurisée pour tous