Google 安全 AI 架構

(SAIF)

AI (尤其是生成式 AI) 具有驚人潛能。創新的同時,業界也需要安全性標準,以負責任的方式打造及部署 AI。因此,我們推出了安全 AI 架構 (SAIF),希望透過這個概念架構加強 AI 系統安全性。

SAIF 六大核心元素

-

為 AI 生態系統奠定堅實的安全性基礎

-

擴大偵測和應變機制的應用範圍,將 AI 納入機構的威脅因應系統

-

透過自動防禦機制因應現有或新興威脅

-

統合平台層級的控管功能,確保整個機構享有一致的安全防護

-

變更控制選項來調整因應措施,並為 AI 部署作業創造更快的回饋循環

-

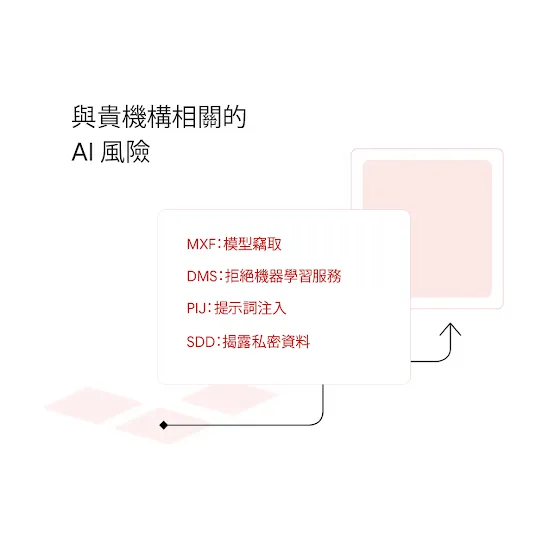

在整體業務流程中判斷 AI 系統風險

促成更安全的生態系統

其他資源

SAIF

常見問題

Google 長久以來一直提倡負責任的 AI 技術及促進網路安全發展,多年來也持續將安全性最佳做法應用於 AI 創新技術。我們根據自身經驗,以及我們制定及採用的最佳做法,設計了安全 AI 架構,反映出 Google 在打造採用機器學習和生成式 AI 技術的應用程式時,也致力導入永續且可擴充的回應式隱私與安全防護措施。我們會持續改進及擴充 SAIF 來因應新興威脅、瞬息萬變的大環境,以及 AI 領域的最新發展。

請參閱導入 SAIF 架構的 快速指南 :

- 步驟 1 - 瞭解用途

- 瞭解要透過 AI 解決的特定業務問題,以及訓練模型所需的資料,進而決定導入 SAIF 所需採用的政策、規範和控管功能。

- 步驟 2 - 籌組團隊

- 如同傳統系統,打造及部署 AI 系統需要跨領域人員的配合。

- AI 系統往往複雜又難以理解、包含大量移動式元件、仰賴許多資料和資源、可套用根據判斷結果產生的決定,並可能會產生令人反感、有害,或加深刻板印象或社會偏見的新內容。

- 組建適當的跨部門團隊,確保團隊從一開始就將安全性、隱私權、風險和法規遵循納入考量。

-

步驟 3 - 瞭解 AI 的基本概念以利確立基準

- 當團隊開始評估業務用途,以及各種不斷演進的複雜問題、風險和適用安全控管功能時,相關人員必須瞭解 AI 模型開發生命週期的基礎知識 ,以及各種模型方法的設計和邏輯,包括功能、好處及限制。

-

步驟 4 - 實踐 SAIF 六大核心元素

- 這些元素可適時實行,沒有順序限制。

請密切留意相關消息!Google 會持續打造並分享安全 AI 架構的相關資源、指南和工具,以及其他開發 AI 應用程式的最佳做法。

為什麼我們支持為所有人打造安全的 AI 社群