Googles säkerhetsramverk för AI

(SAIF)

Möjligheterna med AI, särskilt generativ AI, är otaliga. I takt med att nya idéer utvecklas behövs säkerhetsstandarder så att branschen skapar och implementerar AI på ett ansvarsfullt sätt. Därför har vi lanserat säkerhetsramverket för AI (SAIF), ett konceptuellt säkerhetsramverk för AI-system.

De sex viktigaste delarna i SAIF

-

Utökar starka säkerhetsgrunder till AI-ekosystemet

-

Utökar identifieringen och motåtgärder med hjälp av AI i organisationens hothantering

-

Automatisera skydden för att ligga steget före befintliga och nya hot

-

Synkronisera kontroller på plattformsnivå för att säkerställa att säkerheten är konsekvent i hela organisationen

-

Anpassa kontroller för att ändra begränsningar och skapa snabbare feedbackloopar för implementering av AI

-

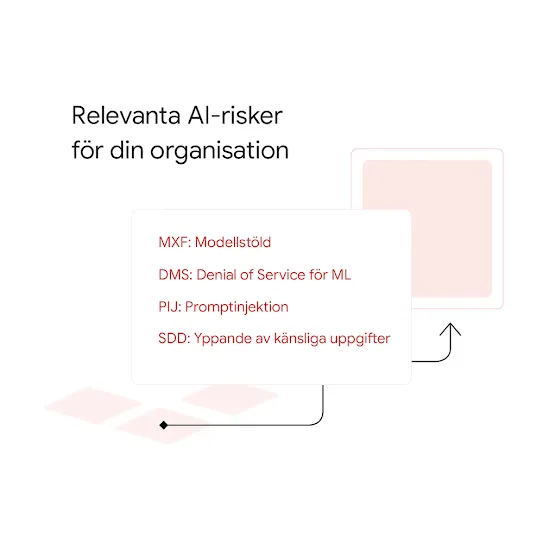

Sätt risker med AI-system i sitt sammanhang i företagsprocesser

Möjliggöra ett säkrare ekosystem

Fler resurser

Vanliga frågor

om SAIF

Google har länge satsat på ansvarsfull AI och utveckling av cybersäkerhet, och vi har utarbetat den bästa säkerhetspraxisen för AI-innovation i många år. Vårt säkerhetsramverk för AI grundar sig på lång erfarenhet och praxis som vi har utvecklat och implementerat. Det vilar dessutom på Googles tillvägagångssätt för att utveckla appar som drivs med ML och generativ AI, med responsiva, hållbara och skalbara skydd för integritet och säkerhet. Vi fortsätter att utveckla SAIF för att kunna hantera nya risker, förändrade förutsättningar och framsteg inom AI.

Läs vår snabbguide om hur SAIF-ramverket kan implementeras:

- Steg 1: Förstå användningen

- Börja med att förstå det specifika affärsproblemet som AI:n ska lösa och vilken data som behövs för att träna modellen. Använd de insikterna för att avgöra vilka principer, protokoll och kontroller som behöver implementeras enligt SAIF.

- Steg 2: Samla teamet

- Precis som med traditionella system behövs kunskap från många olika områden för att utveckla och implementera AI-system.

- AI-system är ofta komplexa och svåröverskådliga, har många olika komponenter, behöver stora mängder data, är resurskrävande, kan användas för att tillämpa omdömesbaserade beslut och generera nytt innehåll som kan vara stötande, skadligt eller främja stereotyper och fördomar.

- Det är viktigt att sätta ihop ett team med rätt specialkompetenser för att ta hänsyn till säkerhet, integritet, risk och efterlevnad redan från början.

-

Steg 3: Se till att alla är insatta med hjälp av en introduktion till AI

- Det är viktigt att alla parter förstår grunderna i AI-modellens utvecklingslivscykel , utformningen och logiken bakom modellmetodiken, inklusive möjligheter, fördelar och begränsningar, när teamen utvärderar hur AI kan användas på företaget.

-

Steg 4: Tillämpa de sex viktigaste delarna i SAIF

- Du behöver inte tillämpa delarna i kronologisk ordning.

Håll utkik! Google skapar och delar kontinuerligt resurser, vägledning och verktyg för säkerhetsramverket för AI, samt andra rekommenderade metoder för utveckling av AI-program.

Därför stödjer vi en säker AI-community för alla