Secure AI Framework (SAIF) da Google

O potencial da IA, especialmente da IA generativa, é imenso. À medida que a inovação avança, a indústria precisa de normas de segurança para criar e implementar a IA de forma responsável. Foi por isso que introduzimos a Secure AI Framework (SAIF), uma framework conceptual para garantir a segurança dos sistemas de IA.

Seis elementos fundamentais da SAIF

-

Expanda bases de segurança sólidas para o ecossistema de IA

-

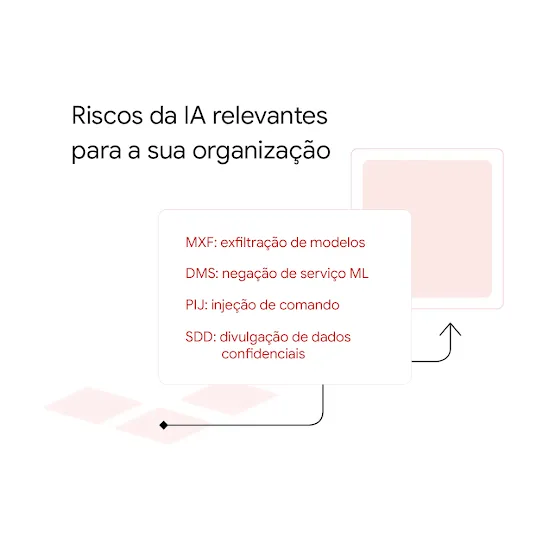

Alargue a deteção e a resposta para introduzir a IA no universo de ameaças de uma organização

-

Automatize as defesas para acompanhar o ritmo das ameaças existentes e das novas

-

Harmonize os controlos ao nível da plataforma para garantir uma segurança consistente em toda a organização

-

Adapte os controlos para ajustar as mitigações e criar ciclos de feedback mais rápidos para a implementação da IA

-

Contextualize os riscos dos sistemas de IA nos processos empresariais circundantes

Permitir um ecossistema mais seguro

Recursos adicionais

Perguntas frequentes

sobre a SAIF

A Google tem uma longa tradição de impulsionar o desenvolvimento da cibersegurança e da IA de forma responsável, e há muitos anos que mapeia as práticas recomendadas de segurança para a inovação da IA. A nossa Secure AI Framework baseia-se no conjunto de experiências e práticas recomendadas que desenvolvemos e implementámos, e reflete a abordagem da Google para a criação de apps com tecnologia de IA generativa e aprendizagem automática, com proteções adaptáveis, sustentáveis e escaláveis para a segurança e a privacidade. Vamos continuar a evoluir e a desenvolver a SAIF para fazer face a novos riscos, panoramas em constante mudança e avanços na IA.

Consulte o nosso guia rápido para implementar a framework SAIF:

- Passo 1 – Compreenda a utilização

- Compreender o problema comercial específico que a IA vai resolver e os dados necessários para treinar o modelo vai ser útil para orientar a política, os protocolos e os controlos que têm de ser implementados como parte da SAIF.

- Passo 2 – Reúna a equipa

- Tal como acontece com os sistemas tradicionais, a programação e a implementação de sistemas de IA são esforços multidisciplinares.

- Os sistemas de IA são frequentemente complexos e opacos, incluem um grande número de variáveis, dependem de grandes quantidades de dados, consomem muitos recursos, podem ser usados para aplicar decisões baseadas em juízos de valor e podem gerar novo conteúdo que pode ser ofensivo, prejudicial ou perpetuar estereótipos e preconceitos sociais.

- Crie a equipa multifuncional adequada para garantir que as considerações de segurança, privacidade, risco e conformidade são incluídas desde o início.

-

Passo 3 – Estabeleça noções básicas com uma introdução à IA

- À medida que as equipas iniciam a avaliação da utilização comercial, das várias complexidades em constante evolução, dos riscos e dos controlos de segurança aplicáveis, é fundamental que as partes envolvidas compreendam as noções básicas do ciclo de vida da programação do modelo de IA, o design e a lógica das metodologias do modelo, incluindo as capacidades, os méritos e as limitações.

-

Passo 4 – Aplique os seis elementos fundamentais da SAIF

- Estes elementos não se destinam a ser aplicados por ordem cronológica.

Mantenha-se a par de tudo! A Google vai continuar a criar e partilhar recursos, orientações e ferramentas da Secure AI Framework, bem como outras práticas recomendadas na programação da aplicação da IA.

Porque é que apoiamos uma comunidade de IA mais segura para todos