Secure AI Framework

(SAIF)

של Google

ל-AI, ובמיוחד ל-AI גנרטיבי, יש פוטנציאל עצום. החדשנות לא נפסקת לרגע, והתעשייה צריכה סטנדרטים ליצירה ולפריסה של מערכות AI באופן אחראי. זו הסיבה שהשקנו את Secure AI Framework (SAIF) – מסגרת רעיונית לאבטחה של מערכות AI.

6 יסודות הליבה של SAIF

-

הרחבה של תשתיות אבטחה יעילות לסביבה העסקית של AI

-

שילוב AI בתהליכי הטיפול באיומים בארגון, משלב הזיהוי ועד שלב התגובה

-

אוטומציה של אמצעי הגנה במטרה לעמוד בקצב של איומים קיימים וחדשים

-

יצירת איזון והרמוניה בין אמצעי הבקרה ברמת הפלטפורמה כדי לשמור על אבטחה עקבית בכל חלקי הארגון

-

מסגלים את אמצעי הבקרה כדי לעדכן את דרכי ההתמודדות עם איומים וליצור לולאות משוב מהירות יותר לפריסת AI

-

הצגת הסיכונים למערכות AI בהקשר של התהליכים העסקיים שסובבים אותן

סביבה עסקית בטוחה יותר

מקורות מידע נוספים

שאלות נפוצות

על SAIF

Google מובילה כבר הרבה שנים בפיתוח אבטחת סייבר ו-AI בצורה אחראית, ובהטמעה של שיטות מומלצות בנושאי אבטחה בטכנולוגיות AI חדשניות. זיקקנו את Secure AI Framework מתוך הניסיון שלנו והשיטות המומלצות שפיתחנו והטמענו. המסגרת הרעיונית הזאת משקפת את הגישה של Google לפיתוח אפליקציות שמבוססות על למידת מכונה ועל AI גנרטיבי, וכוללת אמצעים רספונסיביים, עמידים וניתנים להרחבה להגנה על האבטחה ועל הפרטיות. נמשיך לפתח את SAIF במטרה להתמודד עם סיכונים חדשים, סביבות משתנות ופיתוחים בתחום ה-AI.

כדאי לעיין במדריך הקצר שלנו להטמעת SAIF:

- שלב 1 – מבינים מה השימוש המיועד

- כדי לקבוע באילו פרוטוקולים, מדיניות ואמצעי בקרה צריך להשתמש במסגרת SAIF, חשוב להבין מה הבעיה העסקית הספציפית שרוצים לפתור באמצעות ה-AI ואילו נתונים נדרשים לאימון המודל.

- שלב 2 – מרכיבים את הצוות

- הפיתוח והפריסה של מערכות AI הם פעולות רב-תחומיות, ממש כמו במערכות מסורתיות.

- בדרך כלל, מערכות AI הן מורכבות ומעורפלות, יש בהן מספר גדול של חלקים משתנים, הן מתבססות על כמויות גדולות של נתונים, הן צורכות הרבה משאבים, אפשר להשתמש בהן להטמעה של החלטות שמבוססות על שיפוט והן יכולות ליצור תוכן חדש שעלול להיות פוגעני או מזיק או שעלול להיתפס כסטריאוטיפ או הטיה חברתית.

- מקימים צוות רב-תחומי מתאים כדי לוודא ששיקולי אבטחה, פרטיות, סיכון ותאימות נכללים מההתחלה.

-

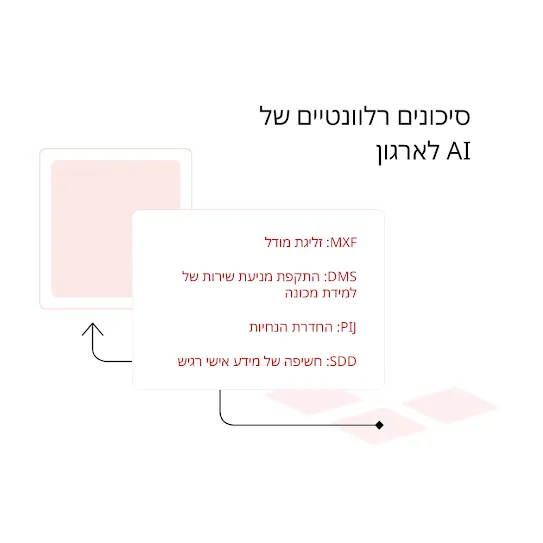

שלב 3 – קובעים את הבסיס עם מדריך למתחילים בנושא AI

- בזמן שהצוותים מתחילים לבחון את השימוש העסקי ב-AI ואת המורכבויות, אמצעי הבקרה על האבטחה והסיכונים השונים והמתפתחים שרלוונטיים למצב – חשוב מאוד שהגורמים המעורבים יבינו את היסודות של סבבי הפיתוח של מודל ה-AI , ואת המבנה והלוגיקה של המתודולוגיות במודל, כולל היכולות, היתרונות והמגבלות.

-

שלב 4 – מטמיעים את 6 יסודות הליבה של SAIF

- אין צורך להטמיע את היסודות לפי סדר כרונולוגי.

כדאי להמשיך להתעדכן! Google תמשיך לפתח ולשתף משאבים, מקורות מידע, הנחיות וכלים שקשורים ל-Secure AI Framework, וגם שיטות מומלצות אחרות לגבי פיתוח של פתרונות מבוססי-AI.

למה אנחנו תומכים בקהילת AI מאובטחת לכולם