Secure AI Framework (SAIF) od Googlu

Potenciál umělé inteligence, a zejména generativní umělé inteligence, je nezměrný. Vzhledem k nepřetržitému proudu inovací potřebuje i tento obor bezpečnostní standardy pro zodpovědné vytváření a implementaci AI. Proto jsme představili Secure AI Framework (SAIF), koncepční rámec pro bezpečné systémy AI.

Šest základních prvků SAIF

-

Rozšíření silných základů zabezpečení na ekosystém AI

-

Rozšíření detekce a odezvy za účelem začlenění AI do systému organizace pro řešení hrozeb

-

Automatická ochrana, která drží krok se stávajícími i novými hrozbami

-

Harmonizace ovládacích prvků na úrovni platformy za účelem zajištění konzistentního zabezpečení v celé organizaci

-

Úprava ovládacích prvků k přizpůsobení zmírnění a vytvoření rychlejších smyček zpětné vazby pro implementaci AI

-

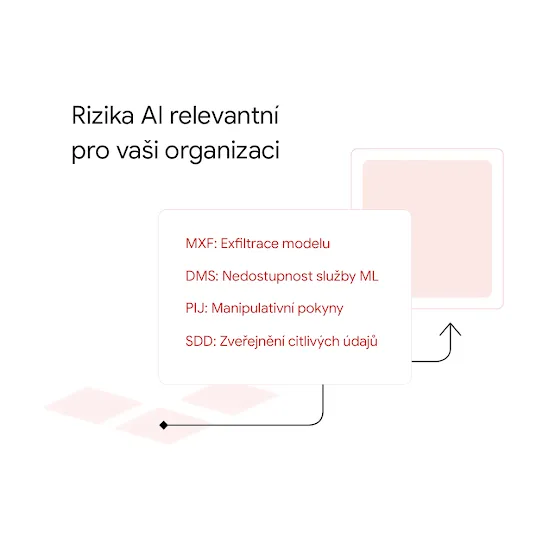

Uvedení rizik systému AI do kontextu s okolními firemními procesy

Zajištění bezpečnějšího ekosystému

Další zdroje

Časté dotazy

ohledně SAIF

Společnost Google už dlouhou dobu podporuje zodpovědný vývoj AI a kyberbezpečnost a řadu let mapuje doporučené postupy zabezpečení inovací v oblasti AI. Náš rámec Secure AI Framework vychází ze spousty zkušeností a doporučených postupů, které jsme vyvinuli a implementovali, a odráží přístup společnosti Google k vytváření aplikací využívajících strojové učení a generativní umělou inteligenci s responzivní, udržitelnou a škálovatelnou ochranou zabezpečení a soukromí. Chceme rámec SAIF dál vyvíjet a přizpůsobovat tak, aby se dokázal vypořádat s novými riziky, měnícím se prostředím a pokroky v oblasti AI.

Přečtěte si našeho rychlého průvodce implementací rámce SAIF:

- Krok 1 – Pochopte použití

- Pochopení konkrétních podnikových problémů, které AI vyřeší, a povědomí o datech potřebných k trénování modelu pomůže s vytvořením zásad, protokolů a ovládacích prvků, které je třeba v rámci SAIF implementovat.

- Krok 2 – Sestavte tým

- Vývoj a implementace systémů AI, stejně jako tradičních systémů, jsou multidisciplinární záležitosti.

- Systémy AI jsou často složité a nepřehledné, zahrnují velké množství pohyblivých částí, spoléhají na velké množství dat, jsou náročné na zdroje, lze je použít k rozhodování na základě úsudku a mohou generovat nový obsah, který může být urážlivý, škodlivý nebo může udržovat stereotypy a sociální předsudky.

- Sestavte správný multifunkční tým, který zajistí, aby se od začátku zohledňovaly aspekty zabezpečení, ochrany soukromí, rizik a dodržování předpisů.

-

Krok 3 – Sjednoťte znalosti pomocí úvodu do AI

- Když týmy začínají vyhodnocovat obchodní využití AI a různé a vyvíjející se složitosti, rizika a bezpečnostní ovládací prvky, které se na ni vztahují, je zásadní, aby všechny zúčastněné strany rozuměly základům životního cyklu vývoje modelu AI, návrhu a logice metodologií modelu, včetně možností, výhod a omezení.

-

Krok 4 – Použijte šest základních prvků SAIF

- Tyto prvky nejsou určeny k použití v chronologickém pořadí.

Sledujte aktuální informace. Google bude dál vytvářet a sdílet zdroje, rady a nástroje související s rámcem Secure AI Framework a další doporučené postupy ohledně vývoje aplikací AI.

Proč podporujeme bezpečnou AI komunitu pro všechny