Khung AI bảo mật của Google

(SAIF)

Tiềm năng của AI, đặc biệt là AI tạo sinh, là vô cùng to lớn. AI không ngừng đổi mới, vì vậy toàn ngành cần có những tiêu chuẩn về bảo mật để xây dựng và triển khai AI một cách có trách nhiệm. Đó là lý do chúng tôi đưa ra Khung AI bảo mật (SAIF), một khung khái niệm hướng đến việc đảm bảo an toàn cho các hệ thống AI.

6 yếu tố cốt lõi của SAIF

-

Mở rộng nền tảng bảo mật vững chắc đến hệ sinh thái AI

-

Mở rộng khả năng phát hiện và ứng phó để đưa AI vào hoạt động giải quyết mối nguy trong tổ chức

-

Tự động hoá cơ chế phòng thủ để kịp thời xử lý những mối nguy mới và hiện hữu

-

Kết hợp hài hoà các biện pháp kiểm soát ở cấp độ nền tảng để đảm bảo an toàn một cách nhất quán trên toàn tổ chức

-

Áp dụng các biện pháp kiểm soát để điều chỉnh cơ chế giảm thiểu rủi ro và tạo ra vòng hồi tiếp nhanh hơn cho việc triển khai AI

-

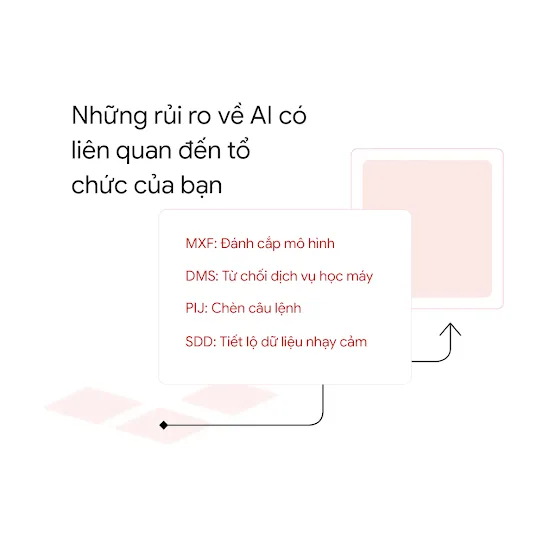

Tìm hiểu các rủi ro ở hệ thống AI trong các quy trình thực tiễn liên quan của doanh nghiệp

Thúc đẩy một hệ sinh thái an toàn hơn

Tài nguyên khác

Câu hỏi thường gặp

về SAIF

Google đã có thời gian dài thúc đẩy việc phát triển an ninh mạng và AI có trách nhiệm, đồng thời đã áp dụng các phương pháp hay nhất về bảo mật vào những cải tiến về AI trong nhiều năm qua. Khung AI bảo mật được đúc kết từ bề dày kinh nghiệm và các phương pháp hay nhất mà chúng tôi đã phát triển và triển khai. Ngoài ra, khung này cũng phản ánh cách tiếp cận của Google trong việc xây dựng ứng dụng dựa trên AI tạo sinh và công nghệ học máy bằng các biện pháp bảo vệ bền vững, có khả năng thích ứng và có thể mở rộng, hướng tới đảm bảo tính bảo mật và quyền riêng tư. Chúng tôi sẽ tiếp tục phát triển và xây dựng SAIF trước những rủi ro mới, những bối cảnh đầy biến động và những tiến bộ về AI.

Xem hướng dẫn nhanh về cách triển khai SAIF:

- Bước 1 – Hiểu rõ mục đích sử dụng

- Việc hiểu được vấn đề kinh doanh cụ thể mà AI xử lý và dữ liệu cần có để huấn luyện mô hình sẽ góp phần thúc đẩy chính sách, giao thức và chế độ kiểm soát cần được triển khai trong SAIF.

- Bước 2 – Tập hợp đội ngũ

- Việc phát triển và triển khai hệ thống AI là một nỗ lực đòi hỏi sự phối hợp của nhiều bộ phận, cũng tương tự như những hệ thống thông thường.

- Các hệ thống AI thường phức tạp và khó hiểu, mang số lượng lớn những yếu tố đầy biến động, cần đến một lượng dữ liệu khổng lồ và tiêu tốn nhiều tài nguyên. Hơn nữa, chúng có thể được sử dụng trong quá trình đánh giá để ra quyết định, cũng như có thể tạo ra nội dung mới có nguy cơ gây phản cảm, gây hại hoặc lưu truyền định kiến và thiên kiến xã hội.

- Hãy lập các phòng ban liên ngành phù hợp để đảm bảo rằng các yếu tố về bảo mật, quyền riêng tư, rủi ro và tuân thủ được xem xét ngay từ đầu.

-

Bước 3 – Nắm rõ kiến thức cơ bản về AI

- Khi các nhóm bắt đầu đánh giá việc sử dụng AI trong doanh nghiệp, họ sẽ gặp phải các vấn đề phức tạp, rủi ro và các biện pháp bảo mật hiện hành. Những yếu tố này rất đa dạng và liên tục phát triển. Do vậy, các bên có liên quan nhất thiết phải nắm được kiến thức cơ bản về vòng đời phát triển mô hình AI cũng như thiết kế và logic của hệ phương pháp lập mô hình, gồm cả các tính năng, ưu điểm và hạn chế.

-

Bước 4 – Áp dụng 6 yếu tố cốt lõi của SAIF

- Những yếu tố này không nhất thiết phải được áp dụng theo trình tự thời gian.

Hãy chú ý theo dõi! Google sẽ không ngừng xây dựng và chia sẻ các nguồn tài nguyên, tài liệu hướng dẫn và công cụ liên quan đến Khung AI bảo mật, cùng với các phương pháp hay nhất khác về việc phát triển hoạt động ứng dụng AI.

Lý do chúng tôi hỗ trợ việc xây dựng một cộng đồng AI bảo mật cho mọi người