Secure AI Framework

(SAIF) Google

AI, khususnya AI generatif, memiliki potensi yang sangat besar. Seiring dengan kemajuan inovasi, industri membutuhkan standar keamanan untuk membangun dan men-deploy AI secara bertanggung jawab. Karena itulah kami memperkenalkan Secure AI Framework (SAIF), yaitu framework konseptual untuk mengamankan sistem AI.

Enam elemen inti SAIF

-

Memperluas fondasi keamanan yang kuat ke ekosistem AI

-

Memperluas deteksi dan respons terhadap ancaman dengan menghadirkan AI ke sistem pertahanan organisasi

-

Mengotomatiskan pertahanan untuk mengimbangi ancaman baru dan yang sudah ada

-

Menyelaraskan kontrol level platform untuk memastikan keamanan yang konsisten di seluruh organisasi

-

Menyesuaikan kontrol untuk kebutuhan mitigasi dan mempercepat feedback loop untuk deployment AI

-

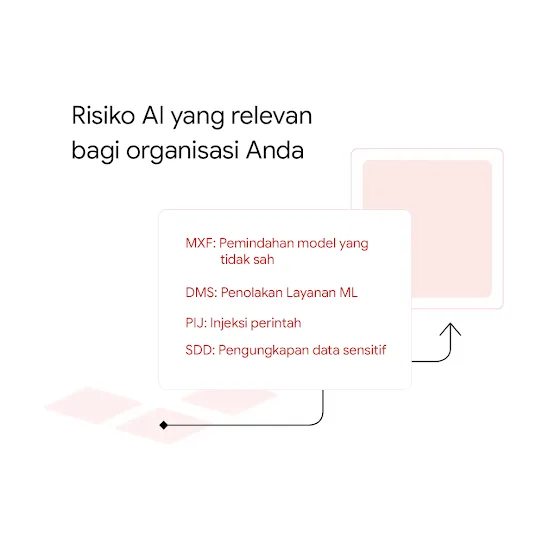

Memahami risiko sistem AI dalam konteks proses bisnis

Mewujudkan ekosistem yang lebih aman

Referensi lainnya

Pertanyaan umum

tentang SAIF

Google memiliki sejarah panjang dalam mendorong pengembangan responsible AI dan pengamanan cyber. Kami juga telah memetakan praktik terbaik keamanan ke dalam inovasi AI selama bertahun-tahun. Secure AI Framework dikembangkan berdasarkan akumulasi pengalaman dan praktik terbaik yang telah kami kembangkan dan terapkan. Framework ini juga mencerminkan pendekatan Google dalam mengembangkan ML dan aplikasi yang didukung AI generatif, dengan perlindungan yang responsif, berkelanjutan, dan skalabel untuk menjaga keamanan dan privasi. Kami akan terus mengembangkan dan membangun SAIF untuk mengatasi berbagai risiko baru, perubahan kondisi, dan kemajuan dalam AI.

Lihat panduan singkat kami untuk menerapkan framework SAIF:

- Langkah 1 - Pahami penggunaannya

- Memahami masalah bisnis tertentu yang akan ditangani oleh AI serta data yang diperlukan untuk melatih model akan membantu meningkatkan kualitas kebijakan, protokol, dan kontrol yang perlu diterapkan sebagai bagian dari SAIF.

- Langkah 2 - Bentuk tim

- Sama seperti sistem tradisional, mengembangkan dan men-deploy sistem AI membutuhkan upaya multidisiplin.

- Sistem AI sering kali rumit dan sulit dipahami, mencakup banyak komponen yang kompleks, bergantung pada data dalam jumlah besar, dan membutuhkan banyak sumber daya. Sistem AI juga dapat digunakan untuk menerapkan keputusan berbasis interpretasi dan dapat menghasilkan konten baru yang mungkin menyinggung, berbahaya, atau dapat melanggengkan stereotipe dan bias sosial.

- Bentuk tim lintas fungsi yang tepat untuk memastikan aspek keamanan, privasi, risiko, dan kepatuhan telah dipertimbangkan sejak awal.

-

Langkah 3 - Samakan pemahaman dasar tentang AI

- Saat tim mulai mengevaluasi penggunaan AI untuk bisnis, mereka akan menghadapi berbagai kompleksitas, risiko, dan kontrol keamanan yang berlaku dan terus berkembang. Penting bagi semua pihak yang terlibat untuk memahami dasar-dasar siklus proses pengembangan model AI , desain dan logika metodologi model, termasuk kemampuan, manfaat, dan batasannya.

-

Langkah 4 - Terapkan enam elemen inti SAIF

- Elemen ini tidak dimaksudkan untuk diterapkan secara berurutan.

Nantikan kabar terbarunya. Google akan terus membangun dan membagikan referensi, panduan, dan alat Secure AI Framework, beserta praktik terbaik lainnya dalam pengembangan aplikasi AI.

Alasan kami mendukung komunitas AI yang aman untuk semua orang