Secure AI Framework od Google

(SAIF)

Potencjał AI, a w szczególności generatywnej AI, jest olbrzymi. Wraz z rozwojem innowacyjnych rozwiązań branża potrzebuje standardów bezpieczeństwa w obszarze odpowiedzialnego tworzenia i wdrażania AI. Z tego względu przedstawiamy Secure AI Framework (SAIF) – koncepcyjną platformę dla bezpiecznych systemów AI.

6 podstawowych elementów SAIF

-

Rozszerzenie silnych mechanizmów zabezpieczających na ekosystem AI

-

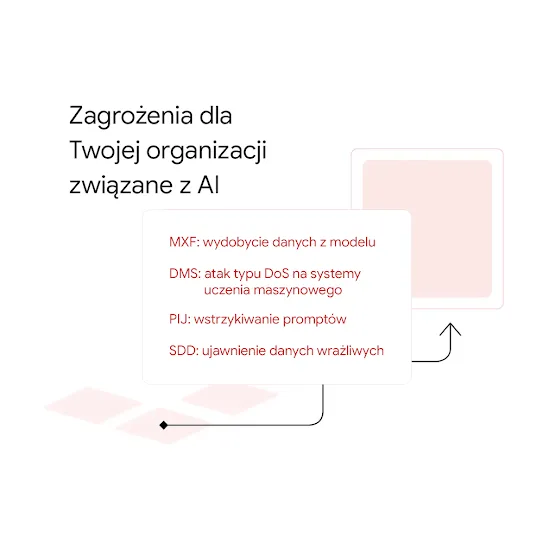

Rozszerzenie wykrywania i reagowania przez włączenie AI do krajobrazu zagrożeń, przed którymi stoi organizacja

-

Automatyzacja obrony w celu dotrzymania kroku istniejącym i nowym zagrożeniom

-

Harmonizacja ustawień na poziomie platformy w celu zapewnienia spójności zabezpieczeń w całej organizacji

-

Dostosowanie ustawień pod kątem skorygowania działania środków ograniczających ryzyko i skrócenia pętli informacji zwrotnych przy wdrażaniu AI

-

Ocenianie ryzyka dotyczącego systemów AI w kontekście stosowanych procesów biznesowych

Większe bezpieczeństwo ekosystemu

Dodatkowe materiały

Często zadawane pytania

na temat SAIF

Google szczyci się długą historią promowania odpowiedzialnego rozwoju sztucznej inteligencji i cyberbezpieczeństwa. Od wielu lat wprowadzamy sprawdzone metody z zakresu bezpieczeństwa do innowacyjnych rozwiązań w dziedzinie AI. Secure AI Framework jest wynikiem naszego doświadczenia i sprawdzonych metod, które opracowaliśmy i wdrożyliśmy. Platforma odzwierciedla podejście Google do tworzenia aplikacji opartych na uczeniu maszynowym i generatywnej AI, które zapewnia elastyczne, zrównoważone i skalowalne mechanizmy zabezpieczeń oraz ochrony prywatności. Będziemy kontynuować rozwój i tworzenie SAIF w odpowiedzi na nowe zagrożenia, ciągłe zmiany i postępy w obszarze AI.

Zapoznaj się z naszym krótkim przewodnikiem po wdrażaniu platformy SAIF:

- Krok 1. Określ zastosowanie

- Zrozumienie konkretnego problemu do rozwiązania przez AI i dostarczenie danych do trenowania modelu pomoże kształtować zasady, protokoły i metody nadzoru, które należy wdrożyć w ramach SAIF.

- Krok 2. Zbierz zespół

- Rozwijanie i wdrażanie systemów AI, podobnie jak w przypadku tradycyjnych systemów, wymaga współpracy specjalistów z wielu dziedzin.

- Systemy AI są często złożone i nieprzejrzyste. Posiadają wiele zmiennych, opierają się na dużej ilości danych, są wymagające pod względem zasobów, mogą być wykorzystywane do podejmowania decyzji opartych na osądzie, a także do generowania nowych treści, które mogą okazać się obraźliwe i szkodliwe lub które utrwalają stereotypy i uprzedzenia społeczne.

- Zbuduj odpowiedni zespół wielozadaniowy, który od początku uwzględni kwestie bezpieczeństwa, prywatności, ryzyka i zgodności z przepisami.

-

Krok 3. Przedstaw informacje dotyczące AI

- Gdy zespoły przystępują do określenia zastosowania biznesowego, a także oceny różnorodnych i narastających złożoności, zagrożeń oraz środków bezpieczeństwa, kluczowe znaczenie ma zrozumienie przez zaangażowane strony podstaw cyklu życia rozwoju modelu AI , projektu i logiki metodologii modelu, w tym jego możliwości, zalet i ograniczeń.

-

Krok 4. Zastosuj 6 podstawowych elementów SAIF

- Te elementy nie muszą być wdrażane w porządku chronologicznym.

Więcej informacji już wkrótce. Google będzie nadal opracowywać i udostępniać zasoby, wskazówki i narzędzia dotyczące Secure AI Framework wraz z innymi sprawdzonymi metodami w zakresie programowania aplikacji opartych na AI.

Dlaczego wspieramy społeczność zajmującą się bezpieczną AI