Framework de IA segura do Google

(SAIF)

O potencial da IA, principalmente da IA generativa, é imenso. Conforme a inovação avança, o setor precisa de padrões de segurança para desenvolver e implantar a inteligência artificial de maneira responsável. Por isso apresentamos o framework de IA segura (SAIF, na sigla em inglês), uma estrutura conceitual que oferece mais segurança aos sistemas de IA.

Seis elementos principais do SAIF

-

Gerar fundamentos de segurança reforçados no ecossistema de IA

-

Estender a detecção e a resposta para usar IA no combate a ameaças em organizações

-

Automatizar defesas para monitorar ameaças novas e antigas

-

Ajustar os controles no nível da plataforma para garantir uma segurança consistente em toda a organização

-

Fazer adaptações em controles para ajustar mitigações e criar ciclos de feedback mais rápidos na implantação de IA

-

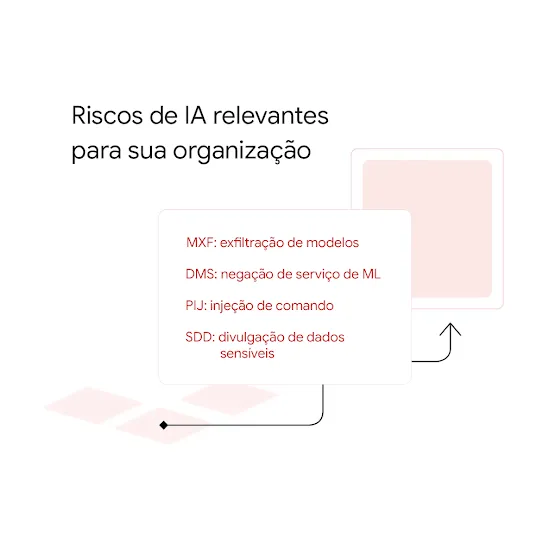

Contextualizar os riscos dos sistemas de IA nos processos comerciais de apoio

Criação de um ecossistema mais seguro

Outros recursos

Perguntas frequentes

sobre o SAIF

O Google tem um longo histórico de desenvolvimento de IA responsável e cibersegurança. Há vários anos, mapeamos as práticas recomendadas de segurança relacionadas a inovações na área. Nosso framework de IA segura surge desse conjunto de experiências e práticas recomendadas que desenvolvemos e implementamos. Isso reflete a abordagem do Google ao criar apps baseados em tecnologia de ML e IA generativa, com proteções responsivas, sustentáveis e escalonáveis para sua segurança e privacidade. Vamos continuar desenvolvendo o SAIF para que ele possa lidar com novos riscos, cenários variáveis e avanços em inteligência artificial.

Confira nosso guia rápido para implementar o SAIF:

- Etapa 1: entender o uso

- Entender qual problema específico do seu negócio a IA vai resolver e os dados necessários para treinar o modelo ajuda a desenvolver a política, os protocolos e os controles que precisam ser implementados como parte do SAIF.

- Etapa 2: montar a equipe

- Desenvolver e implantar sistemas de IA, assim como sistemas tradicionais, é um esforço multidisciplinar.

- Sistemas de IA costumam ser complexos e difíceis de entender, com muito componentes em funcionamento, depender de grandes quantidades de dados e precisar de muitos recursos. Eles podem ser usados para ajudar na tomada de decisões (junto com a interação humana) e podem gerar novos conteúdos potencialmente ofensivos, nocivos ou que perpetuam estereótipos e preconceitos sociais.

- Defina a equipe multifuncional correta para garantir que segurança, privacidade e considerações sobre risco e compliance estejam incluídas desde o início.

-

Etapa 3: nivelar o conhecimento com um manual de IA

- Conforme as equipes começarem a avaliar os usos comerciais e os vários riscos, complexidades e controles de segurança aplicáveis, será essencial que todas as partes envolvidas entendam o básico sobre o ciclo de vida do desenvolvimento de modelos de IA , o design e a lógica das metodologias do modelo, incluindo capacidades, vantagens e limitações.

-

Etapa 4: aplicar os seis elementos principais do SAIF

- Não é necessário aplicar os elementos em ordem cronológica.

Não perca as novidades! O Google vai continuar criando e compartilhando recursos, guias e ferramentas sobre o framework de IA segura, além de outras práticas recomendadas relacionadas ao desenvolvimento de aplicativos de IA.